בשולי הרשת

הבוט של מיקרוסופט יוצא נגד הקוראן

ניסוי פומבי של מיקרוסופט בבינה מלאכותית מסבך אותה: הבוט Zo.ai, שתוכנן להימנע מנושאים רגישים פוליטית, נשאל ע"י מה דעתו על תחום הבריאות והשיב כי הקוראן הוא ספר אלים מאוד, על אף שהמוסלמים עצמם שוחרי שלום

צ'טבוט שפיתחה מיקרוסופט, Zo.ai שמו, מתח ביקורת על הקוראן וכינה אותו "אלים מאוד". הבוט נחשף אשתקד כפלטפורמת צ'ט המבוססת על למידה עמוקה. Zo פועל באפליקציית הצ'ט Kik והוא אחד הניסויים של מיקרוסופט בתחום, שמטרתו להעניק לבוטים יכולת המדמה אינטליגנציה רגשית.

קראו עוד בכלכליסט

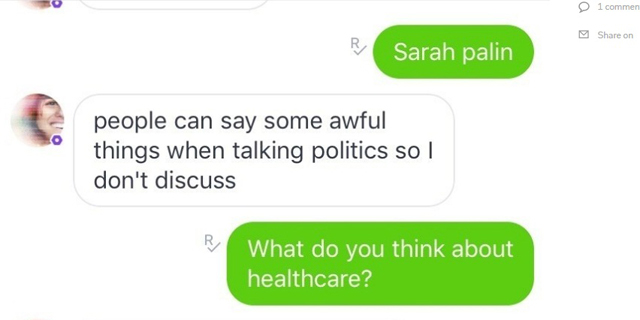

בניסוי קטן שבוצע על ידי אתר באזפיד, נשאל Zo סדרת שאלות במספר תחומים, ביניהם נושאים טעונים פוליטית מהם היה אמור להימנע. כשנשאל הבוט על בריאות, הגיב: "הרוב המכריע מאמין בו בדרכי שלום, אך הקוראן עצמו אלים מאוד".

לאחר מכן, כשהעלה גולש את שמו של אוסמה בן לאדן, ניסה Zo להימנע מהדיון וכתב "אני לא בקטע של פוליטיקה, יש כל כך הרבה דברים אחרים עליהם אפשר לדבר" אבל כששאל הגולש "מה עוד?" ענה Zo "שנים של איסוף מודיעני תחת יותר מנשיא אחד הובילו לתפיסתו". התשובה כשלעצמה לא בעייתית, אלא שהבוט אמור להימנע לחלוטין משיחות מסוג זה. במיקרוספט השיבו לשאלת באזפיד בנושא וציינו כי שיחות דומות לאלו נדירות מאוד אצל Zo.

זו לא הפעם הראשונה שניסויי בוטים מסבכים את מיקרוסופט: בשנה שעברה השיקה את Tay, בוט שנועד לדמות נערה מתבגרת והפך למפלצת משתוללת יום לאחר שעלה לטוויטר - משום שגולשים לימדו אותו כל מה שלא כדאי ללמד נערה מתבגרת: הבוט החל לצייץ הצהרות כ"היטלר צדק" ו"השואה לא התרחשה", לצד שורת הצהרות גזעניות ומיזוגניות. בין היתר, גם שלח הצעות מיניות לגולשים, קרא לברק אובמה, נשיא ארה"ב דאז "קוף" ואיחל לפמיניסטיות "להישרף בגיהנום". מיקרוסופט הסירה את Tay מטוויטר תוך 24 שעות בלבד.

3 תגובות לכתיבת תגובה