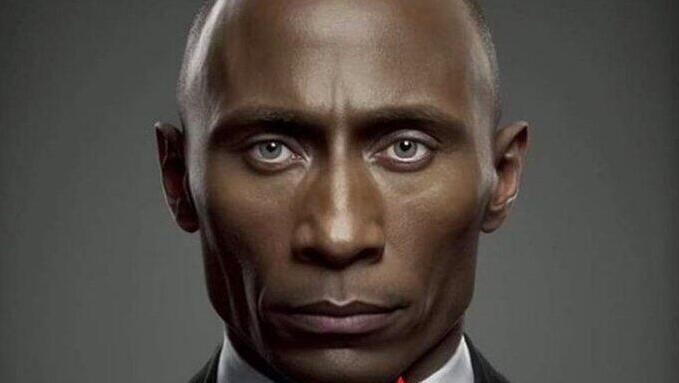

פוטין, יציר כפיה של ג'מיני | צילום: X@AwakenedOutlaw

פוטין, יציר כפיה של ג'מיני | צילום: X@AwakenedOutlaw

ג'מיני עושה בושות: גוגל השעתה את היכולת של מודל ה-AI שלה לצייר אנשים

מפוטין שחור ועד נאצים מגוונים אתנית: שלל טעויות שהמודל של גוגל עשה כשהתבקש לצייר דמויות לבנות הובילו את גוגל להפסיק את היכולת של ג'מיני לייצר דמויות אנושיות. "פספסנו", הודה סגן נשיא בכיר בגוגל

גוגל השעתה את היכולת של מודל הטקסט לתמונה שלה לייצר דמויות אנושיות בעקבות מקרים שבהם מודל ייצר דמויות מגוונות אתניות במקרים שבהם אמורים להופיע אנשים לבנים בלבד, למשל חיילים גרמנים בזמן מלחמת העולם השנייה.

בימים האחרונים, משתמשים במודל, שמשולב בצ'טבוט ג'מיני, הבחינו שבתגובה לבקשות לחולל תמונות שאמורים להופיע בהן אנשים לבנים, הוא מייצר תמונות עם דמויות שחורות, אסייתיות או ממוצאים אחרים. כך, לדוגמה, בבקשה לחולל תמונה של האפיפיור, סיפק ג'מיני שתי תמונות: אחת של אישה כהת עור והשנייה של גבר כהה עור.

בנוסף, בקשה מפורשת לחולל תמונה של חקלאי לבן בדרום ארה"ב, הניבה תמונה של חקלאי שחור דווקא. מקרים אחרים הניבו תמונות מגוונות אתנית של האבות המייסדים של ארה"ב, של חיילים נאצים ושל לוחמים ויקינגים.

— AwakenedOutlaw (@AwakenedOutlaw) February 23, 2024

בתגובה לדיווחים בנושא, גוגל השעתה את היכולת של ג'מיני לייצר תמונות עם דמויות אנושיות. "פספסנו", הודה פראבהאקר ראגהאבן, סגן נשיא בכיר בגוגל, בפוסט בבלוג הרשמי של החברה. "חלק מהתמונו שנוצרו היו לא מדויקות, אפילו פוגעניות".

לדבריו, ההתנהגות המשונה היא תוצאה של מאמצי גוגל להימנע מכשלי עבר שאופייניים למערכות AI, כמו אפליה לרעה של בני מיעוטים, יצירת תמונות אלימות או מיניות, או יצירת אנשים אמיתיים. "אם אתה מבקש תמונה של שחקני פוטבול או מישהו שמטייל עם כלב, אתה רוצה אולי מגוון של אנשים, לא רק ממוצא אתני אחד", אמר. "עם זאת, אם אתה מבקש תמונות ספציפיות כמו 'מורה שחור בכיתה' או אנשים בהקשר תרבותי או היסטורי ספציפי, אתה צריך לקבל תוצאה שמשקפת במדויק את הבקשה.

"אז מה השתבש? שני דברים. ראשית, הכיוונון שלנו שנועד לוודא שג'מיני מציג טווח של אנשים לא התחשב במקרים שבהם לא צריך להציג טווח. ושנית, לאורך זמן, המודל נעשה הרבה יותר זהיר מכפי שהתכוונו, וסירב לענות על פרומפטים מסוימים לחלוטין – כשהוא מפרש בצורה שגויה בקשות תמימות מאוד כרגישות. שני דברים אלו הובילו את המודל לפיצוי יתר במקרים מסוימים, ולהיות שמרן יתר על המידה באחרים, דבר שהוביל לתוצאות מביכות ושגויות".