צילום: Erik Nilsson

צילום: Erik Nilsson

ראיון חג

"את הפריצות המסוכנות ביותר לא מבצעים האקרים אלא העשירים"

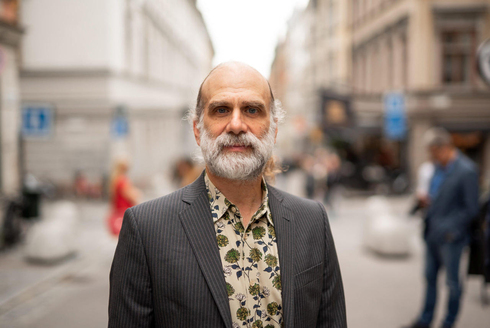

ברוס שנייר, מחוקרי האבטחה המובילים בעולם, מחברם של עשרות ספרים בתחום ומי שזכה לכינוי "גורו האבטחה" ע"י ה"אקונומיסט", משוכנע שההאקרים שאנו מכירים כיום יהיו סוג של משחק ילדים לעומת מה שצפוי לאנושות כבר בעתיד הקרוב. מערכות בינה מלאכותית ימצאו נקודות תורפה בכל המערכות החברתיות, הכלכליות והפוליטיות, ינצלו אותן במהירות ובקנה מידה חסר תקדים, ויעשו זאת עבור העשירים והחזקים: "אז נהיה כבר בצרה צרורה"

כובעים שחורים, כובעים לבנים, האקרים, רוגלות, מתקפות סייבר, NSO וקנדירו. מונחים מעולמות הסייבר ההתקפי וההגנתי ממלאים את מציאות חיינו היום יותר מאי פעם. אבל פריצות, אומר ברוס שנייר, אחד מחוקרי האבטחה המובילים בעולם, יש משחר האנושות, להגביל אותן רק אל משהו שמתרחש במחשבים היא טעות שנשלם עליה ביוקר. "בינה מלאכותית הולכת לפרוץ לחיים שלנו", הוא אומר בראיון לכלכליסט ולא משאיר מקום לטעות. האקרים, הוא מסביר, ימצאו בעתיד הלא רחוק נקודות תורפה בכל המערכות החברתיות, הכלכליות והפוליטיות שלנו, ינצלו אותן במהירות ובקנה מידה חסר תקנה, ויעשו זאת בשביל העשירים והחזקים.

"כשחושבים על האקר את חושבת על מישהו שמסתכל על קוד המחשב וגורם לו לעשות משהו שהוא לא התכוון לעשות", הוא מסביר, "אני חושב שאפשר למשוך את הרעיון הזה לכל מערכת של כללים. חשבי על קוד המס, הוא אינו קוד מחשב, אבל הוא קוד, הוא אלגוריתם. יש לו תשומה ותפוקה, יש לו צעדים. את מזינה את כמות הכסף שהרווחת, התפוקה היא כמות הכסף שאת חייבת. יש גם באגים בקוד המס, יש פגיעות. אנחנו קוראים לפגיעות הזו פרצות מס ויש דרכים לנצל את אלו – בארה"ב אנחנו קוראים להן אסטרטגיות להתחמקות ממס. ויש תעשייה שלמה של האקרים כובעים שחורים (שחקנים רעים – ו"א) שמחפשים למצוא באגים ופרצות כדי לנצל פגיעות בקוד המס. קוראים להם עורכי דין למיסוי ורואי חשבון".

כמו קוד המס, מסביר שנייר, כך אפשר לחשוב גם על המערכת הפיננסית, הפוליטית והחברתית כמערכות מקודדות ומורכבות חשופות לפריצה. כולן כוללות חוקים, כללים ותקנות שאותם בני האדם מנסים לתמרן מקדמת דנא. "את יכולה לחשוב על כל סט של כללים", הוא אומר, "קרנות גידור למשל הן האקרים של המערכת הפיננסית, חלוקת אזורי בחירה היא פריצה למערכת הפוליטית ובוטים פורצים למערכות המידע והחברתיות שלנו. ברגע שמתחילים להתבונן על המערכת כסט של כללים מתחילים לראות פריצות בכל מקום".

בעתיד הלא רחוק בכלל, שנייר מעריך, בני האדם יזינו, ילמדו ויאמנו מערכות בינה מלאכותית (AI) בקודים של המערכות החברתיות, הכלכליות והפוליטיות שלנו – החוקים, הכללים, התקדימים והפסיקות, וישלחו אותן לחפש נקודות תורפה. כשהן ימצאו את אלו, והן ימצאו הוא מבטיח, נהיה בצרה צרורה. משום שברגע שמערכות ממוחשבות יתחילו לחפש פרצות היכן שפעם בני אדם חיפשו, הן ימצאו יותר פרצות, מהר יותר ובאופן שלא היינו מצליחים לחשוב על כך בעצמנו. לעיתים הפריצות יהיו מתוחכמות מכפי שהמוח האנושי היה מעלה על דעתו או שימצאו ממש במקרה, הפער עלול להיות כה גדול עד שלא נבחין כלל שהתרחשה מניפולציה על המערכת, וההונאה תוכל לעבור ללא הבחנה גם שנים.

העתיד אותו חוזה שנייר לא כולל רובוטים רעים, כוונות זדוניות, רגע סינגולרי ואפילו לא פריצת דרך משמעותית במחקר. ממש לא, זהו עתיד שכבר היום יש עדויות מטרימות להתממשותו: מהמסחר האלגוריתמי שמעוות התנהגות שוק מעשה ידי אדם, ועד לצ'אט בוטים שמשבשים את מה שאנחנו חושבים שהוא שיח אותנטי ומידע אמין. "כבר היום פעמים רבות אי אפשר להבחין בין אנשים אמיתיים לצ'אט בוטים וזה רק ילך ויחמיר ככל שהם ילכו וישתפרו וזה ישפיע עלינו עמוקות", שנייר נותן דוגמה ממשית ומסביר את עומק הבעיה לעתיד: "חשבי על האמונות שלנו, ועל האמונות של הסובבים אותנו. אנחנו חברתיים ולכן אנחנו מודדים את רמת סבירות האמונה שלנו על בסיס אנשים סביבנו. אך אם האנשים סביבנו הם לא ממש אנשים אלא בוטים, שתוכנתו על ידי מישהו שנועדו לקדם נקודה מסוימת, אז אנחנו מושפעים על ידי פרופגנדה. מצב כזה מעלה דאגה אמיתית ששיח אמיתי נחנק על ידי השיח המזויף".

"לא תהיה להם תפיסה של קופסה"

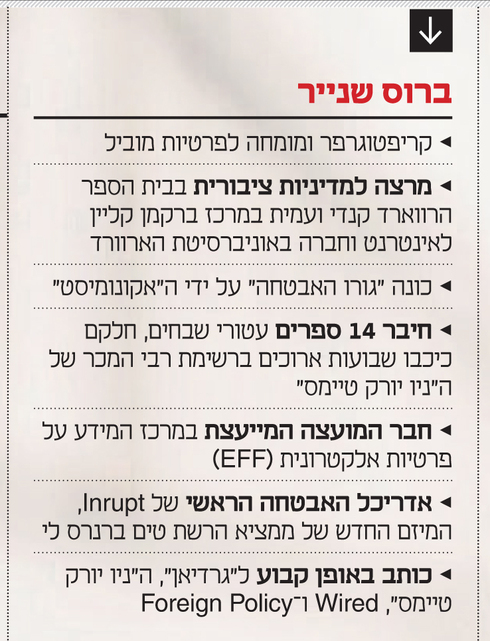

כששנייר מדבר, כדאי להקשיב. מי שכונה "גורו האבטחה" על ידי האקונומיסט הוא מחברם של 14 ספרים עטורי שבחים, חלקם כיכבו שבועות ארוכים ברשימת רבי המכר של ה"ניו יורק טיימס". הוא קריפטוגרפור ומומחה לפרטיות מוביל, ומשמש מרצה למדיניות ציבורית בבית הספר הרווארד קנדי ועמית במרכז ברקמן קליין לאינטרנט וחברה באוניברסיטת הארוורד. הוא חבר המועצה המייעצת במרכז המידע על פרטיות אלקטרונית (EFF), משמש אדריכל האבטחה הראשי של Inrupt המיזם החדש של ממציא הרשת טים ברנרס לי וכותב באופן קבוע ל"גרדיאן", ה"ניו יורק טיימס", Wired ו־Foreign Policy.

עם ניסיונו העשיר והמגוון שנייר נע באסרטיביות בין פרספקטיבות: ממתכנת, דרך חוקר, הומוניסט ואקטיביסט, תנועה שאפשרה לו לטשטש את הגבולות בין המרחב הפיזי, הממוחשב והרעיוני, ולראות כי פריצות או "האקינג" הן למעשה תהליך אנושי שבו היינו מנסים לבצע מניפולציות על מערכות תוך חתירה להשיג עושר, השפעה וכוח, שעובר כעת לידי מערכות ממוחשבות. את החזון העגום שלו פורס שנייר בחיבור יוצא דופן שפורסם במאי האחרון "AI Hackeres" עבור המועצה לשימוש אחראי בבינה מלאכותית, שבו הוא מסביר במיומנות כיצד מערכות של למידת מכונה יאיימו על כל מערכות הכללים והחוקים הקיימים, ומדוע אין דבר נראה לעין שיכול לעצור את התהליך.

כששנייר מדבר על AI הוא מתייחס למערכות שלומדות לבצע משימות על ידי למידה מדוגמאות ולא מתכנות מפורש. מערכות אלו זקוקות למערכי נתונים עצומים מסווגים לקטגוריות, שמהם הן לומדות באמצעות הסקה סטטיסטית. מערכי נתונים אלו יכולים להיות למשל קוד מס בכל העולם כולו, מאגר חוקים, תקנות, תקדימים ופסיקות, מערכות המסחר בעולם או תקנות בחירות. כשבני האדם יבקשו ממערכות בינה מלאכותית לפתור בעיות אותן הם יגדירו כמו למשל "לשלם שיעור מס החוקי הנמוך ביותר" או כשמשקיע יבקש ממערכת שלמדה את מנגנוני ההשקעה השונים במסחר בבורסה למצוא דרך יעילה במיוחד להשיג רווח, הן עלולות למצוא פרצות לכאורה חוקיות, אך כאלו שעבור בני האדם יהיה ברור מבחינת ההקשר שיש בעיה בפתרון שנבחר ונרגיש סטייה או רמאות. זאת משום שהן פשוט לא פותרות בעיות כמו בני אדם. "הן יחשבו מחוץ לקופסה, משום שאין להן תפיסה של קופסה", כותב שנייר.

אך מערכות בינה מלאכותית הן כמו קופסה שחורה, הן גרועות למדי להסביר איך פעלו כפי שפעלו, ולעיתים אין לדעת בכלל שעשו מה שעשו. מה שיראה אולי "פתרון" בעיני המערכת, לא יראה כך בעיני האדם משום שהמערכת לא מבינה מושגים מופשטים של רמאות או אתיקה. היא לא חושבת במונחים של השלכות, הקשר, נורמות וערכים שבני אדם חולקים ומקבלים כמובן מאליהם.

כדי להסביר נקודה זו שנייר מציג את שערוריית יצרנית הרכב פולקסווגן שב־2017 נקנסה ב־2.8 מיליארד דולר משום פיתחה והתקינה תוכנה במעל ל־10 מיליון רכבים מתוצרתה, שכל תכליתה היא לזייף קריאות של פליטות פחמן. הפריצה למערכות הממוחשבות של הרכבים נעשתה למעלה מעשור מבלי שאף אחד ידע על כך מלבד מעצביה, ונחשפה רק במקרה על ידי חוקרים. אלו הן פריצות של בני אדם, כעת, טוען שנייר, תארו לכם שמערכת של בינה מלאכותית תעשה אותו הדבר? תמצא פתרון לבעיה שתנוסח למשל "תכנן מנוע שיביא לביצועים מקסימליים תוך שהוא עובר את כל מבחני בקרת הפליטה". שאלה המנוסחת בתום לב, יכולה להוביל את המערכת להשיג את התוצאה הרצויה, אך כזו שנמצאת מחוץ למסגרת המקובלת, פתרון שיערער את המערכת ויהתל בחוק. אבל בגלל שהמערכת היא קופסה שחורה, לא יהיה ברור כלל מה המערכת עשתה, רואי חשבון, בנקאים, משקיעים או מתכנתים ישמחו, כיסם יתפח, אבל הפתרון של הבינה המלאכותית יהיה במהותי שלילי ואיש לא יבין זאת.

אם נראה לכם שיש אפשרות למנוע מתוצאה בלתי רצויה כזו להתרחש, חשבו שנית. השפה והכוונה האנושית תמיד מקפלת בתוכה מטרות ורצונות לא מוגדרים הוא מסביר, והכללים שלנו לעולם לא מתארים את כל האפשרויות. אנו אף פעם לא סוגרים את כל הדרכים, לעולם אנחנו לא מצליחים להתוות את כל הסייגים והחריגים ולכן כל המערכות שאנחנו בונים אם זו המערכת הבנקאית, המיסוי, או הפוליטית תמיד יסבלו מבאגים שמערכות בינה מלאכותית ימצאו. זו בעיה שכולנו למדנו את הלקח שלה כבר מילדות, מתאר שנייר, כמו למשל בסיפור על מגע הזהב של מידאס. "כשהאל דיוניסוס נותן לו משאלה", הוא כותב, "מידאס מבקש שכל מה שהוא נוגע בו יהפוך לזהב. מידאס מסיים בסופו של דבר רעב ואומלל כשהאוכל, השתייה ואף הבת שלו הופכים כולם לזהב". זו בעיה שמכונה The AI Alignment Problem שמדגישה עד כמה קשה להגדיר מטרות למערכות בינה מלאכותית, המטרה של מידאס היתה להחזיק במשאב בלתי נגמר לעושר, אך הוא הגדיר אותה באופן שגוי במערכת והוא קיבל תוצאה לא רצויה.

"אין איך להתכונן"

שנייר טוען כי זה רק עניין של זמן עד שמערכות למידה יקבלו את המשימה הבעייתית ליעל, לנצל ולפרוץ באלגנטיות את כל מערכות החיים האנושיים וכשזה יקרה, הכל ישתנה. אמנם כבר היום מערכות נפרצות, אך זה נעשה בקצב אנושי, מס הכנסה, המערכת הפוליטית או הפיננסית לא יוכלו להתמודד עם פריצות של AI והן יפגעו מהר יותר משהמערכות יצליחו להתאושש. "הן לא יהיו מוגבלות באותן דרכים, או שיהיו להם אותן גבולות, כמו לאנשים", כותב שנייר, "הן ישנו את המהירות והיקף הפריצה, בשיעורים שאנו לא מוכנים אליהם. בוטים לייצור טקסט מלאכותי, למשל, ישוכפלו במיליונים ברשתות החברתיות. הם יוכלו לעסוק בנושאים מסביב לשעון, לשלוח מיליארדי הודעות ולהציף כל דיון מקוון בין בני אדם. מה שנראה כוויכוח פוליטי סוער יהיה בוטים שמתווכחים עם בוטים אחרים. הם ישפיעו באופן מלאכותי על מה שאנחנו חושבים שהוא נורמלי, על מה שאנחנו חושבים שאחרים חושבים".

יש לו סיבה טובה להאמין בכך, זה כבר מתחיל לקרות. איך למשל? בניסוי שנערך לאחרונה בארה"ב חוקרים השתמשו בתוכנית ייצור טקסטים כדי להגיש אלף הערות לציבור, בתגובה לבקשת הממשל האמריקאי בנוגע לתוכנית הבריאות הציבורית Medicaid. כולם נשמעו ייחודיים, כמו אנשים אמיתיים שמחזיקים בעמדה מדינית ספציפית והם הוליכו שולל את מנהלי התוכנית שראו בהם חששות אמיתיים מאנשים ממשיים.

אבל בראש סדרי העדיפויות, מערכת אחרת לחלוטין. "המקום הראשון שצריך להסתכל עליו הן המערכות הפיננסיות. יש הרבה כסף בלנסות למצוא פרצות במערכת הפיננסית ואנחנו יודעים כבר היום שקרנות גידור מעסיקות מומחים לבינה מלאכותית". השיטה לכאורה לא מאוד מסובכת משום שהמערכת הפיננסית מנוהלת על מחשבים בזמן אמת, תפגישו את המערכות הממוחשבות עם ממשק רלבנטי, תזינו אותה עם חוקים, תקנות וכל מידע אחר רלוונטי ואז שגר אותו עם משימה אחת בודדת "מקסימום רווח באופן חוקי". סביר להניח, שנייר מסיק, שיהיו כמה פרצות שיהיו מעבר להבנה האנושית ולעולם לא נבין שהן מתרחשות. המערכת תעבור מניפולציה עבור מעטים ואין דרך לדעת זאת.

"חשוב לציין שהפריצות הטובות ביותר נעשות לא על ידי האנדרדוג", שנייר מדגיש, "לא על ידי הפושעים או האקרים, אלא על ידי העשירים, בעלי הכוח והממשלות. ההאקרים הטובים ביותר של קוד המס הם העשירים, לא העניים. כשחושבים על האקרים של בינה מלאכותית, תהיה דינמיקת כוח". זאת אומרת שמערכות אלו והפעילות שלהן בשרות אינטרסים צרים מאוד יחזקו במידה רבה את מבני הכוח הקיימים.

כשתהליכים אלו ילכו ויתממשו, מסביר שנייר, המערכות החברתיות והפוליטיות שלנו יעמדו בפני שוקת שבורה. "יש לנו מערכות חברתיות העוסקות בפריצות, אך אלו פותחו כאשר האקרים היו בני אדם, ומשקפות את קצב ההאקרים האנושיים", הוא כותב, "אין לנו שום מערכת שלטון שיכולה להתמודד עם מאות - שלא לדבר על אלפים - פרצות מס שהתגלו לאחרונה. אנחנו פשוט לא יכולים לתקן את קוד המס במהירות. אנחנו לא מסוגלים להתמודד עם אנשים שמשתמשים בפייסבוק כדי לפרוץ דמוקרטיה, שלא לדבר על מה יקרה כאשר בינה מלאכותית תבצע את זה. לא נוכל להתאושש מ- AI המגלה פריצות לא צפויות אך משפטיות של מערכות פיננסיות. במהירות המחשב, פריצה הופכת לבעיה שאנחנו כחברה כבר לא יכולים לנהל".

יש דרך להאט את התהליך הזה, להתגונן?

"אני לא חושב שאפשר. הטכנולוגיה תעשה זאת, אנשים יגרמו לטכנולוגיה לעשות זאת. יש שיטות הגנה, הרעיון שניתן להשתמש גם באותם האקרים ואותה דינמיקה כדי להתגונן. אבל באמת שאין תשובה כרגע. זה יקרה, הרי מה התשובה לפרצות מס? זו אותה השאלה, אתה מנסה לחוקק חוקים בלי פרצות מס, אבל אתה לא יכול כי העשירים והחזקים משכנעים את הקונגרס להכניס פרצות פנימה אל תוך החוקים. כרגע זה משהו שיש לצפות אליו, אבל אין איך להתכונן אליו. זו המטרה של החיבור להגיד היי, זה הולך לקרות, צריך להתחיל לשים לב לזה".

אז נצטרך פשוט לראות את זה קורה ולהגיב בדיעבד?

"כן. זו אינה תשובה טובה אבל לעיתים לשאלות טובות אין תשובות טובות. אבל רק בגלל שאין תשובה כרגע זה לא אומר שאין תשובה כלל. זו בעיה שעלינו לפתור".

מה בכל זאת אפשר לעשות? למנף את המערכות האלו לאתר פריצות מבעוד מועד, לגייס מומחי אבטחה שינסו לזהות את נקודות התורפה במערכות החברתיות השונות שלנו כמו קוד המס ותקנות בחירות, מה ששנייר מכנה "לפרוץ את החברה". אך פעילות זאת תדרוש גמישות יוצאת דופן מצד השלטון ומוסדותיו להגיב ביעילות ובמהירות, לא את השנים הרבות הסטנדרטיות שנדרשות כדי לתקן קוד מס או להעביר שינוי רגולטורי בתקנות בנקאות. במיוחד ששינויים מהירים מסוג זה יתקלו בכוח עז, של אותם בעלי עוצמה שאיתרו את הפרצות, להותיר אותם על כנם.